Promptfoo

Promptfoo es una herramienta de codigo abierto para probar y evaluar salidas de LLM. Compara modelos, ejecuta evaluaciones de red team y detecta regresiones con una interfaz web integrada.

Servicios

promptfoo

ghcr.io/promptfoo/promptfoo:0.121.3Promptfoo

Framework de pruebas y evaluacion de LLM de codigo abierto. Compara calidad de prompts entre modelos, detecta regresiones y ejecuta evaluaciones de seguridad.

Que puedes hacer despues del despliegue

- Visita tu dominio — la interfaz web carga inmediatamente

- Crea evaluaciones — define casos de prueba y compara salidas entre modelos

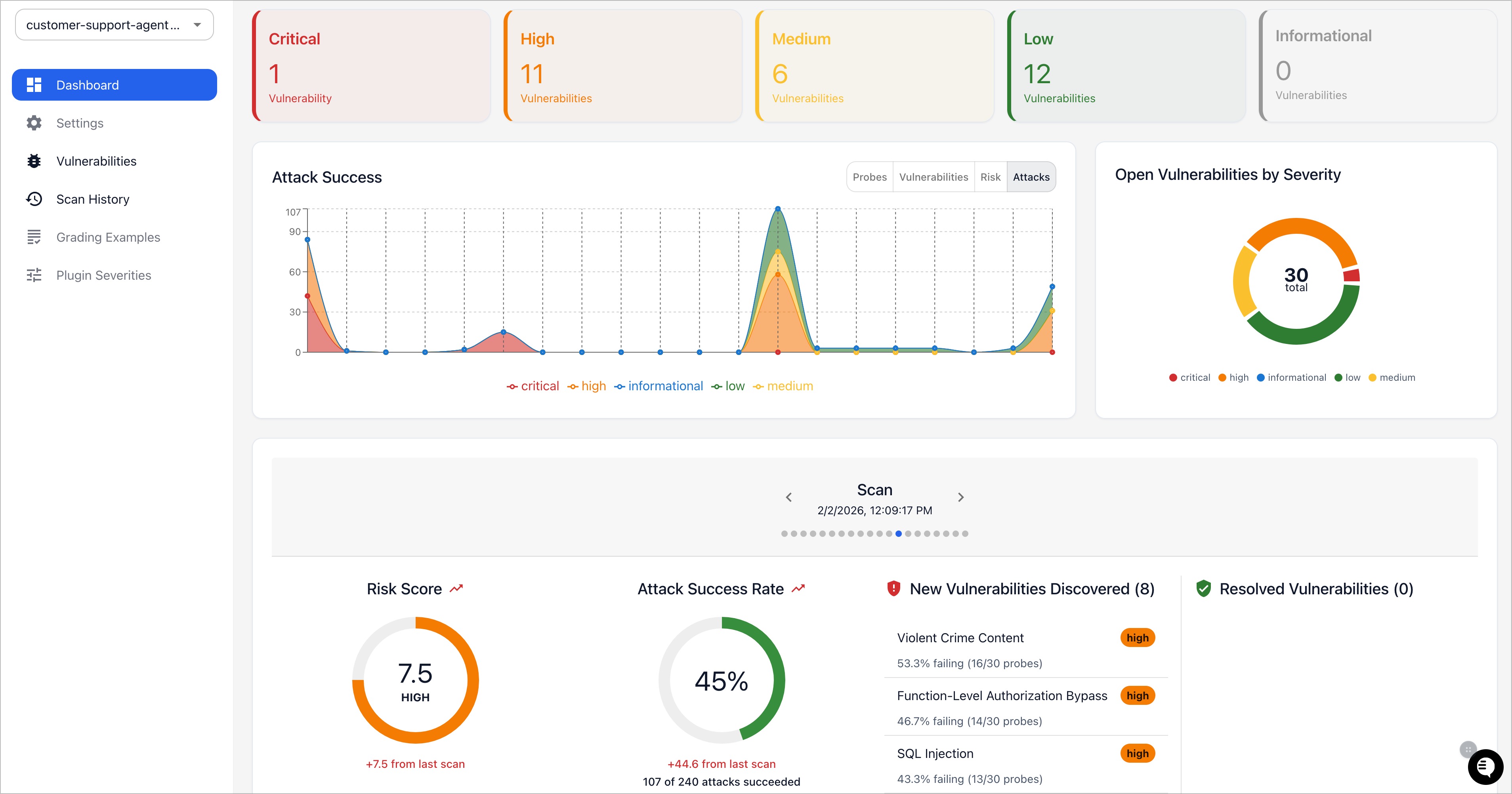

- Ejecuta evaluaciones red team — detecta automaticamente inyeccion de prompts y vulnerabilidades

- Ve resultados — tablas comparativas con puntuacion de aprobado/fallido

- Exporta informes — comparte resultados con tu equipo

Casos de uso

- Ingenieria de prompts y pruebas A/B

- Seleccion de modelos y benchmarking

- Seguridad de LLM y red teaming

- Integracion CI/CD para pruebas de regresion

- Comparacion de costos y latencia entre proveedores

Licencia

MIT — GitHub